| Fisher-Snedecor

|

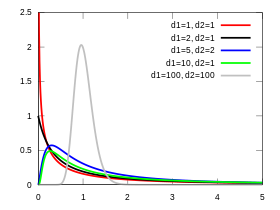

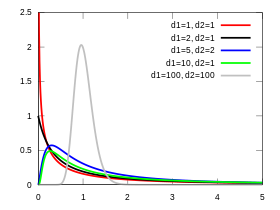

Densité de probabilité

|

|

|

|

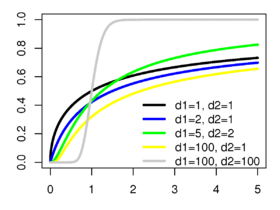

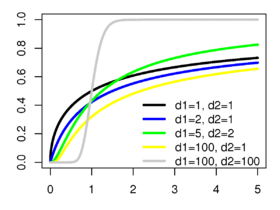

Fonction de répartition

|

|

| Paramètres

|

degré de liberté degré de liberté

|

| Support

|

|

| Densité de probabilité

|

|

| Fonction de répartition

|

|

| Espérance

|

pour pour

|

| Mode

|

pour pour

|

| Variance

|

pour pour

|

| Asymétrie

|

pour pour

|

| Kurtosis normalisé

|

pour pour

|

modifier  |

En théorie des probabilités et en statistiques, la loi de Fisher ou encore loi de Fisher-Snedecor ou encore loi F de Snedecor est une loi de probabilité continue[1],[2],[3]. Elle tire son nom des statisticiens Ronald Aylmer Fisher et George Snedecor.

La loi de Fisher survient très fréquemment en tant que loi de la statistique de test lorsque l'hypothèse nulle est vraie, dans des tests statistiques, comme les tests du ratio de vraisemblance, dans les tests de Chow utilisés en économétrie, ou encore dans l'analyse de la variance (ANOVA) via le test de Fisher.

Une variable aléatoire réelle distribuée selon la loi de Fisher peut être construite comme le quotient de deux variables aléatoires indépendantes, U1 et U2, distribuées chacune selon une loi du χ² et ajustées pour leurs nombres de degrés de liberté, respectivement d1 et d2 :

.

.

La densité de probabilité d'une loi de Fisher, F(d1, d2), est donnée par

pour tout réel x ≥ 0, où d1 et d2 sont des entiers positifs et B est la fonction bêta.

pour tout réel x ≥ 0, où d1 et d2 sont des entiers positifs et B est la fonction bêta.

La fonction de répartition associée est :

où I est la fonction bêta incomplète régularisée.

où I est la fonction bêta incomplète régularisée.

La loi binomiale est liée à la loi de Fisher par la propriété suivante[4]:

si X suit une loi binomiale de paramètres n et p, et si k est un entier compris entre 0 et n, alors  où F suit une loi de Fisher de paramètres

où F suit une loi de Fisher de paramètres  avec

avec

L'espérance, la variance valent respectivement

pour d2 > 2 et

pour d2 > 2 et

pour d2 > 4. Pour d2 > 8, le kurtosis normalisé est

pour d2 > 4. Pour d2 > 8, le kurtosis normalisé est  .

.

Une généralisation de la loi de Fisher est la loi de Fisher non-centrée (en).